L’IA continue de transformer le domaine de l’imagerie médicale, notamment en automatisant des tâches complexes comme la segmentation d’organes ou de lésions. Parmi les projets récents, Medical SAM3 se distingue comme un modèle de fondation conçu pour segmenter des images médicales de manière universelle et guidée par prompts.

Découvrir le projet Medical-SAM3 sur GitHub

Pour rappel SAM 3 (Segment Anything Model 3) est le modèle de fondation publié par Meta pour la segmentation de concepts promptables (PCS). La tâche PCS prend une requête conceptuelle en entrée et génère des masques de segmentation avec des identités uniques pour toutes les instances d'objets correspondantes.

Medical SAM3 est une variante de ce modèle de fondation dédiée à la segmentation d’images médicales qui peut être guidée via différents types de prompts pour identifier des structures anatomiques.

Nous retrouvons :

Il repose sur une adaptation complète du modèle SAM3, fine-tuné sur de grands ensembles de données médicales hétérogènes en 2D et 3D, comprenant des masques de segmentation et des instructions textuelles associées. Bien loin du prompt engineering, il s’agit d’une adaptation paramétrique complète.

Pourquoi cette adaptation ? Parce que les modèles généralistes rencontrent souvent des difficultés face aux images médicales :

Les chercheurs ont également constaté que les performances de SAM3 chutaient sur les données médicales et dépendaient parfois de repères géométriques très précis, comme des bounding boxes issues de la vérité terrain.

C’est pourquoi Medical SAM3 a vu le jour, avec l’objectif de combiner flexibilité des prompts et compréhension spécifique du domaine médical.

L’idée centrale consiste à adapter entièrement les paramètres du modèle, et pas seulement à optimiser les prompts.

Pour cela, le modèle a été entraîné sur 33 datasets couvrant 10 modalités d’imagerie médicale dans le but d’acquérir des représentations robustes tout en conservant une interaction guidée par prompts.

Le code proposé permet notamment :

Les expérimentations montrent des gains de performance constants, surtout dans des situations difficiles : ambiguïté sémantique, morphologies complexes ou contexte 3D étendu.

En clair : Medical SAM3 cherche à devenir un universel de segmentation médicale guidée par texte.

Contrairement aux versions précédentes, SAM 3 peut trouver et segmenter chaque instance d'un concept apparaissant n'importe où dans des images ou des vidéos.

De plus, il est maintenant possible de spécifier des invites textuelles ou des exemples d’images : le texte décrit le concept à rechercher, tandis que l’exemple visuel sert de référence pour repérer et segmenter des objets similaires.

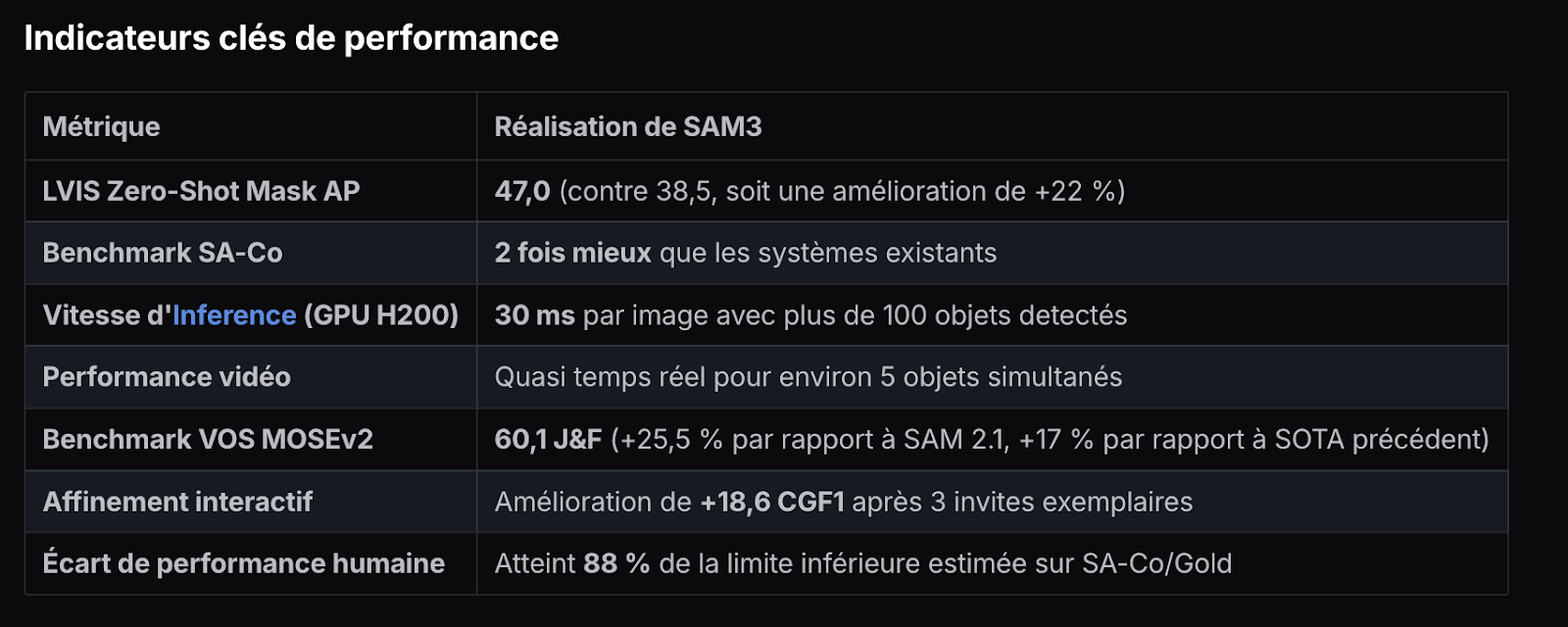

Selon l’équipe qui l’a développée, SAM3 double les performances des systèmes existants dans la segmentation de concepts promptables tout en maintenant et en améliorant les capacités de SAM2 pour la segmentation visuelle interactive.

Medical SAM3 est une variante du modèle SAM3 dédiée à l’analyse d’imagerie médicale.

Cette version de SAM3 est fine-tunée sur un important volume de données médicales variées et hétérogènes, présentant de la 2D et de la 3D. Ces images sont accompagnées de métadonnées comme des masques de segmentation et d’instructions textuelles.

Il s’agit donc d’une adaptation paramétrique complète permettant d’améliorer les performances de SAM3 sur des données d’imageries médicales.

En étant entraîné sur un large éventail de datasets et de modalités, Medical SAM3 adopte une logique proche des modèles généralistes mais spécialisée pour le médical.

Cela ouvre la voie à des outils capables de fonctionner sur différents organes, formats d’image ou dimensions sans avoir à multiplier les chaînes de traitement.

Les résultats suggèrent qu’une adaptation holistique du modèle est essentielle pour obtenir une segmentation robuste face aux changements de domaine.

C’est un message important pour les équipes IA : parfois, optimiser l’interface ne suffit pas, il faut repenser le cœur du modèle.

Les tests couvrant organes, modalités et dimensions montrent des améliorations significatives, notamment lorsque la structure anatomique est difficile à interpréter.

Autrement dit, le modèle ne se contente pas d’exceller sur des cas “propres”, il vise aussi la robustesse clinique, qui reste toutefois encore expérimentale début 2026.

Le projet propose un environnement complet pour tester le modèle et le confronter à d’autres approches, ce qui facilite la recherche et la projection vers une possible industrialisation.

Un signal positif pour l’écosystème open source en santé.

Les modèles de segmentation ne sont pas qu’un exercice académique, ils sont au cœur de nombreux workflows médicaux.

Une segmentation fiable peut, par exemple, accélérer l’identification de tumeurs, lésions ou anomalies en fournissant des contours précis pour l’analyse clinique.

Medical SAM3, qui tend vers un modèle universel dans un cadre expérimental, permet d’analyser plus rapidement de grands volumes de données d’imagerie, facilitant les études multi-organes ou multi-modalités.

La capacité à fonctionner via prompts peut réduire la nécessité de configurer des modèles spécialisés pour chaque tâche.

Un modèle commun peut contribuer à homogénéiser les méthodes de segmentation entre institutions, un enjeu clé pour la reproductibilité scientifique.

Medical SAM3 illustre une tendance forte de l’IA : l’émergence de modèles de fondation spécialisés par domaine.

En combinant adaptation complète du modèle, entraînement à grande échelle et interaction guidée par prompts, il propose une approche ambitieuse pour rendre la segmentation médicale plus robuste et potentiellement plus accessible.

Si les résultats de Medical SAM3 restent expérimentaux et nécessitent des validations cliniques avant tout usage médical, une trajectoire semble se confirmer et ce type de modèle pourrait devenir un composant central des futures plateformes d’imagerie médicale au même titre que les LLM le sont devenus pour le texte.

👉 Lire le papier Medical SAM3 sur arXiv